Samsung’un yeni nesil HBM4 belleklerinin 2024’ün 4. çeyreğinde banttan çıkacağı ve seri üretime gireceği paylaşıldı. NVIDIA’nın yeni nesil Rubin R100 AI GPU’su için seri üretim ise yine 2025’in 4. çeyreğinde planlanıyor.

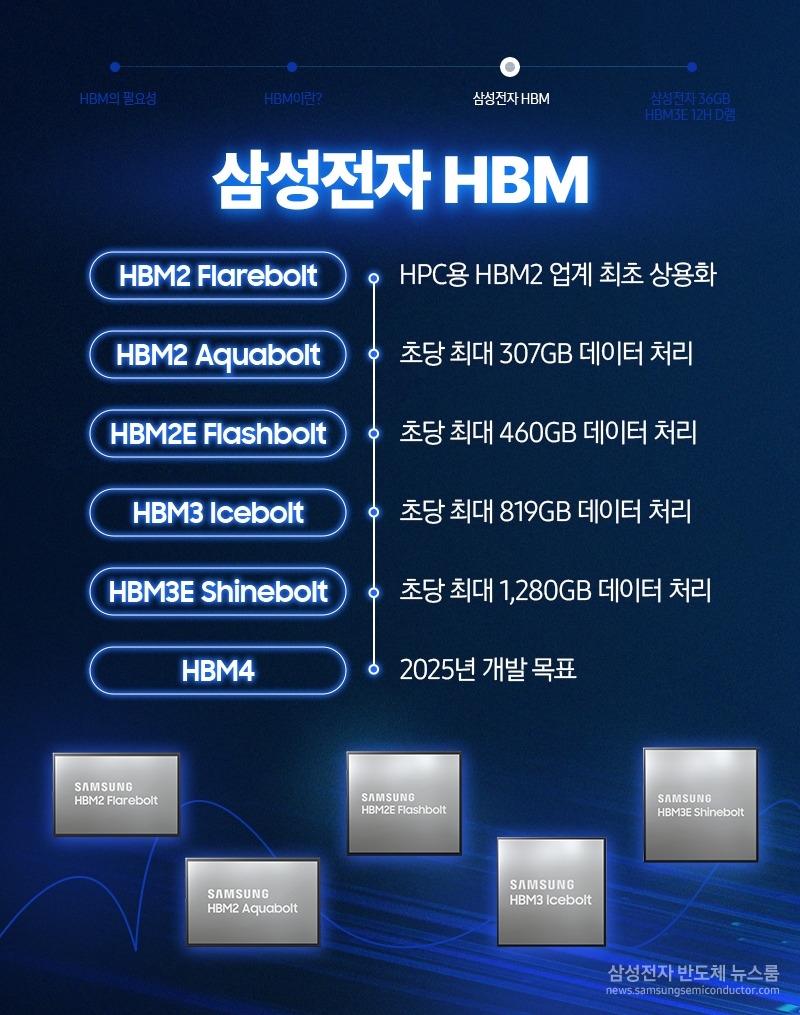

AI endüstrisi HBM belleklerin büyümesini destekliyor. HBM üreticileri SK hynix, Samsung ve Micron elinden geldiğince çok sayıda bellek üretiyor fakat bunun henüz yeterli seviyede olmadığı söyleniyor. SK hynix, hem 2024 hem de 2025 için tüm HBM3 ve HBM3E’lerini satmış durumda. Ufukta HBM4 gözükmüşken de akıllara, NVIDIA ve AMD gibi AI GPU şirketlerine en büyük HBM4 tedarikçisinin kim olabileceği sorusu geliyor.

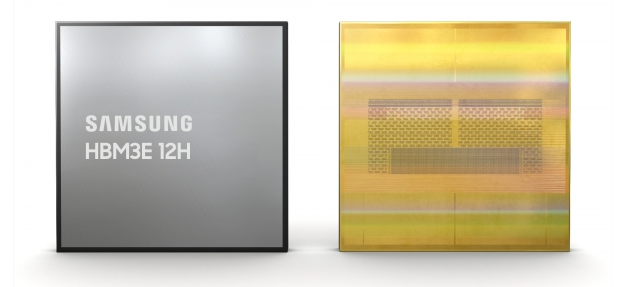

NVIDIA’nın yeni nesil Rubin R100 AI GPU’su HBM4 bellekleri kullanacak. Bu yüzden 2025 ve sonrası için daha fazla HBM belleği üretmek için SK hynix ve Samsungûn ellerinden gelen her şeyi yaptığı ve onlarca milyar dolar harcayarak Güney Kore, Tayvan ve Amerika Birleşik Devletleri’nde yarı iletken fabrikaları kurup genişletmeye başladıkları belirtiliyor. The Elec ise Samsung’un HBM4 üzerinde ön çalışmalara başladığını ve 2024’ün 4. çeyreğinde banttan çıkmasının beklediğini bildirmiş. Yani banttan çıkması, ürünün tasarım ve üretim metodolojilerinin tamamlandığı anlamına geliyor.

NVIDIA’nın yeni nesil Blackwell B100 ve B200 AI GPU’ları bildiğiniz üzere yeni HBM3E bellek standardını kullanacak. Ancak şirket halihazırda ultra hızlı HBM4 belleği kullanacak olan gelecek nesil Rubin R100 AI GPU’sunu duyurdu ve Rubin R100 AI GPU’ları 2025’in 4. çeyreğinde piyasaya sürülecek